本文目錄:

4.1 文件系統的組成部分

4.2 文件系統的完整結構

4.3 Data Block

4.4 inode基礎知識

4.5 inode深入

4.6 單文件系統中文件操作的原理

4.7 多文件系統關聯

4.8 ext3文件系統的日志功能

4.9 ext4文件系統

4.10 ext類文件系統的缺點

4.11 虛擬文件系統VFS

將磁盤進行分區,分區是將磁盤按柱面進行物理上的劃分。劃分好分區后還要進行格式化,然后再掛載才能使用(不考慮其他方法)。格式化分區的過程其實就是創建文件系統。

文件系統的類型有很多種,如CentOS 5和CentOS 6上默認使用的ext2/ext3/ext4,CentOS 7上默認使用的xfs,windows上的NTFS,光盤類的文件系統ISO9660,MAC上的混合文件系統HFS,網絡文件系統NFS,Oracle研發的btrfs,還有老式的FAT/FAT32等。

本文將非常全面且詳細地對ext家族的文件系統進行介紹。有ext2/ext3/ext4,ext3是有日志的ext2改進版,ext4對相比ext3做了非常多的改進。雖然xfs/btrfs等文件系統有所不同,但它們只是在實現方式上不太同,再加上屬于自己的特性而已。

4.1 文件系統的組成部分

4.1.1 block的出現

硬盤的讀寫IO一次是一個扇區512字節,如果要讀寫大量文件,以扇區為單位肯定很慢很消耗性能,所以Linux中通過文件系統控制使用”塊”為讀寫單元。現在的文件系統上,塊的大小一般為1024bytes(1K)或2048bytes(2K)或4096bytes(4K)。比如需要讀一個或多個塊時,文件系統的IO管理器通知磁盤控制器要讀取哪些塊的數據,硬盤控制器將這些塊按扇區讀取出來,再通過硬盤控制器將這些扇區數據重組返回給計算機。

block的出現使得在文件系統層面上讀寫性能大大提高,也大量減少了碎片。但是它的副作用是可能造成空間浪費。由于文件系統以block為讀寫單元,即使存儲的文件只有1K大小也將占用一個block,剩余的空間完全是浪費的。在某些業務需求下可能大量存儲小文件,這會浪費大量的空間。

盡管有缺點,但是其優點足夠明顯,在當下硬盤容量廉價且追求性能的時代,使用block是一定的。

4.1.2 inode的出現

如果存儲的1個文件占用了大量的block讀取時會如何?假如block大小為1KB,僅僅存儲一個10M的文件就需要10240個block,而且這些blocks很可能在位置上是不連續在一起的(不相鄰),讀取該文件時難道要從前向后掃描整個文件系統的塊,然后找出屬于該文件的塊嗎?顯然是不應該這么做的,因為太慢太傻瓜式了。再考慮一下,讀取一個只占用1個block的文件,難道只讀取一個block就結束了嗎?并不是,仍然是掃描整個文件系統的所有block,因為它不知道什么時候掃描到,掃描到了它也不知道這個文件是不是已經完整而不需要再掃描其他的block。

另外,每個文件都有屬性(如權限、大小、時間戳等),這些屬性類的元數據存儲在哪里呢?難道也和文件的數據部分存儲在塊中嗎?如果一個文件占用多個block那是不是每個屬于該文件的block都要存儲一份文件元數據?但是如果不在每個block中存儲元數據文件系統又怎么知道某一個block是不是屬于該文件呢?但是顯然,每個數據block中都存儲一份元數據太浪費空間。

文件系統設計者當然知道這樣的存儲方式很不理想,所以需要優化存儲方式。如何優化?對于這種類似的問題的解決方法是使用索引,通過掃描索引找到對應的數據,而且索引可以存儲部分數據。

在文件系統上索引技術具體化為索引節點(index node),在索引節點上存儲的部分數據即為文件的屬性元數據及其他少量信息。一般來說索引占用的空間相比其索引的文件數據而言占用的空間就小得多,掃描它比掃描整個數據要快得多,否則索引就沒有存在的意義。這樣一來就解決了前面所有的問題。

在文件系統上的術語中,索引節點稱為inode。在inode中存儲了inode號、文件類型、權限、文件所有者、大小、時間戳等元數據信息,最重要的是還存儲了指向屬于該文件block的指針,這樣讀取inode就可以找到屬于該文件的block,進而讀取這些block并獲得該文件的數據。由于后面還會介紹一種指針,為了方便稱呼和區分,暫且將這個inode記錄中指向文件data block的指針稱之為block指針,。

一般inode大小為128字節或256字節,相比那些MB或GB計算的文件數據而言小得多的多,但也要知道可能一個文件大小小于inode大小,例如只占用1個字節的文件。

4.1.3 bmap出現

在向硬盤存儲數據時,文件系統需要知道哪些塊是空閑的,哪些塊是已經占用了的。最笨的方法當然是從前向后掃描,遇到空閑塊就存儲一部分,繼續掃描直到存儲完所有數據。

優化的方法當然也可以考慮使用索引,但是僅僅1G的文件系統就有1KB的block共1024*1024=1048576個,這僅僅只是1G,如果是100G、500G甚至更大呢,僅僅使用索引索引的數量和空間占用也將極大,這時就出現更高一級的優化方法:使用塊位圖(bitmap簡稱bmap)。

位圖只使用0和1標識對應block是空閑還是被占用,0和1在位圖中的位置和block的位置一一對應,第一位標識第一個塊,第二個位標識第二個塊,依次下去直到標記完所有的block。

考慮下為什么塊位圖更優化。在位圖中1個字節8個位,可以標識8個block。對于一個block大小為1KB、容量為1G的文件系統而言,block數量有1024*1024個,所以在位圖中使用1024*1024個位共1024*1024/8=131072字節=128K,即1G的文件只需要128個block做位圖就能完成一一對應。通過掃描這100多個block就能知道哪些block是空閑的,速度提高了非常多。

但是要注意,bmap的優化針對的是寫優化,因為只有寫才需要找到空閑block并分配空閑block。對于讀而言,只要通過inode找到了block的位置,cpu就能迅速計算出block在物理磁盤上的地址,cpu的計算速度是極快的,計算block地址的時間幾乎可以忽略,那么讀速度基本認為是受硬盤本身性能的影響而與文件系統無關了。

雖然bmap已經極大的優化了掃描,但是仍有其瓶頸:如果文件系統是100G呢?100G的文件系統要使用128*100=12800個1KB大小的block,這就占用了12.5M的空間了。試想完全掃描12800個很可能不連續的block這也是需要占用一些時間的,雖然快但是扛不住每次存儲文件都要掃描帶來的巨大開銷。

所以需要再次優化,如何優化?簡而言之就是將文件系統劃分開形成塊組,至于塊組的介紹放在后文。

4.1.4 inode表的出現

回顧下inode相關信息:inode存儲了inode號、文件屬性元數據、指向文件占用的block的指針;每一個inode占用128字節或256字節。

現在又出現問題了,一個文件系統中可以說有無數多個文件,每一個文件都對應一個inode,難道每一個僅128字節的inode都要單獨占用一個block進行存儲嗎?這太浪費空間了。

所以更優的方法是將多個inode合并存儲在block中,對于128字節的inode,一個block存儲8個inode,對于256字節的inode,一個block存儲4個inode。這就使得每個存儲inode的塊都不浪費。

在ext文件系統上,將這些物理上存儲inode的block組合起來,在邏輯上形成一張inode表(inode table)來記錄所有的inode。

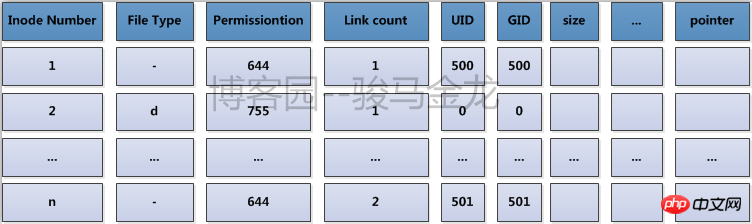

舉個例子,每一個家庭都要向派出所登記戶口信息,通過戶口本可以知道家庭住址,而每個鎮或街道的派出所將本鎮或本街道的所有戶口整合在一起,要查找某一戶地址時,在派出所就能快速查找到。inode table就是這里的派出所。它的內容如下圖所示。

實際上,在文件系統創建完成后所有的inode號都已經分配好并記錄到inode table中了,只不過被使用的inode號所在的行還有文件屬性的元數據信息和block位置信息,而未被使用的inode號只有一個inode號而已而沒有其他信息而已。

再細細一思考,就能發現一個大的文件系統仍將占用大量的塊來存儲inode,想要找到其中的一個inode記錄也需要不小的開銷,盡管它們已經形成了一張邏輯上的表,但扛不住表太大記錄太多。那么如何快速找到inode,這同樣是需要優化的,優化的方法是將文件系統的block進行分組劃分,每個組中都存有本組inode table范圍、bmap等。

4.1.5 imap的出現

前面說bmap是塊位圖,用于標識文件系統中哪些block是空閑哪些block是占用的。

對于inode也一樣,在存儲文件(Linux中一切皆文件)時需要為其分配一個inode號。但是在格式化創建文件系統后所有的inode號都是被事先設定好存放在inode table中的,因此產生了問題:要為文件分配哪一個inode號呢?又如何知道某一個inode號是否已經被分配了呢?

既然是”是否被占用”的問題,使用位圖是最佳方案,像bmap記錄block的占用情況一樣。標識inode號是否被分配的位圖稱為inodemap簡稱為imap。這時要為一個文件分配inode號只需掃描imap即可知道哪一個inode號是空閑的。

imap存在著和bmap和inode table一樣需要解決的問題:如果文件系統比較大,imap本身就會很大,每次存儲文件都要進行掃描,回導致效率不夠高。同樣,優化的方式是將文件系統占用的block劃分成塊組,每個塊組有自己的imap范圍。

4.1.6 塊組的出現

前面一直提到的優化方法是將文件系統占用的block劃分成塊組(block group),解決bmap、inode table和imap太大的問題。

在物理層面上的劃分是將磁盤按柱面劃分為多個分區,即多個文件系統;在邏輯層面上的劃分是將文件系統劃分成塊組。每個文件系統包含多個塊組,每個塊組包含多個元數據區和數據區:元數據區就是存儲bmap、inode table、imap等的數據;數據區就是存儲文件數據的區域。注意塊組是邏輯層面的概念,所以并不會真的在磁盤上按柱、按扇區、按磁道等概念進行劃分。

4.1.7 塊組的劃分

塊組在文件系統創建完成后就已經劃分完成了,也就是說元數據區bmap、inode table和imap等信息占用的block以及數據區占用的block都已經劃分好了。那么文件系統如何知道一個塊組元數據區包含多少個block,數據區又包含多少block呢?

它只需確定一個數據——每個block的大小,再根據bmap至多只能占用一個完整的block的標準就能計算出塊組如何劃分。如果文件系統非常小,所有的bmap總共都不能占用完一個block,那么也只能空閑bmap的block了。

每個block的大小在創建文件系統時可以人為指定,不指定也有默認值。

假如現在block的大小是1KB,一個bmap完整占用一個block能標識1024*8= 8192個block(當然這8192個block是數據區和元數據區共8192個,因為元數據區分配的block也需要通過bmap來標識)。每個block是1K,每個塊組是8192K即8M,創建1G的文件系統需要劃分1024/8=128個塊組,如果是1.1G的文件系統呢?128+12.8=128+13=141個塊組。

每個組的block數目是劃分好了,但是每個組設定多少個inode號呢?inode table占用多少block呢?這需要由系統決定了,因為描述”每多少個數據區的block就為其分配一個inode號”的指標默認是我們不知道的,當然創建文件系統時也可以人為指定這個指標或者百分比例。見后文”inode深入”。

使用dumpe2fs可以將ext類的文件系統信息全部顯示出來,當然bmap是每個塊組固定一個block的不用顯示,imap比bmap更小所以也只占用1個block不用顯示。

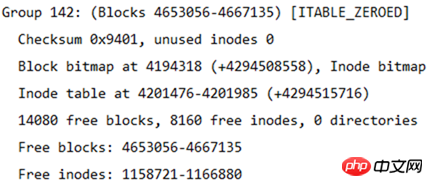

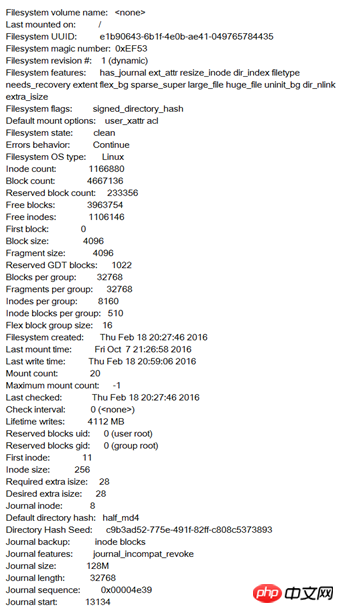

下圖是一個文件系統的部分信息,在這些信息的后面還有每個塊組的信息。

從這張表中能計算出文件系統的大小,該文件系統共4667136個blocks,每個block大小為4K,所以文件系統大小為4667136*4/1024/1024=17.8GB。

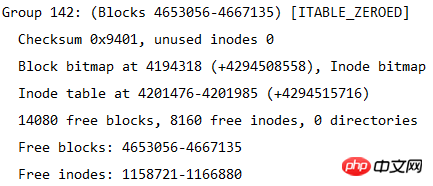

也能計算出分了多少個塊組,因為每一個塊組的block數量為32768,所以塊組的數量為4667136/32768=142.4即143個塊組。由于塊組從0開始編號,所以最后一個塊組編號為Group 142。如下圖所示是最后一個塊組的信息。

4.2 文件系統的完整結構

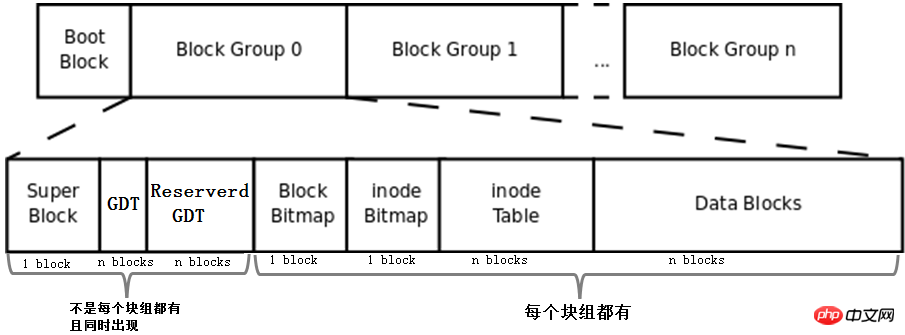

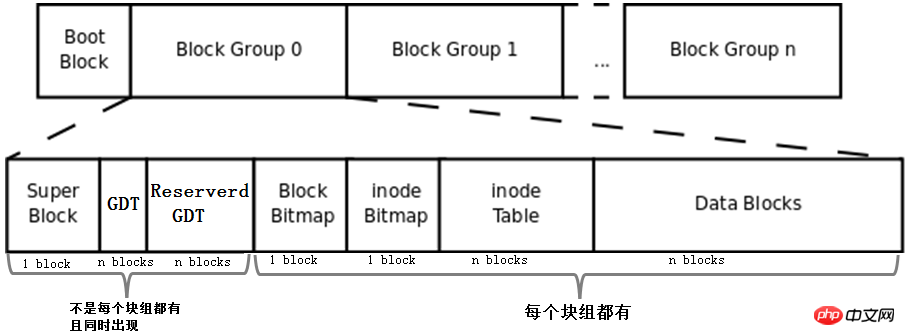

將上文描述的bmap、inode table、imap、數據區的blocks和塊組的概念組合起來就形成了一個文件系統,當然這還不是完整的文件系統。完整的文件系統如下圖。

首先,該圖中多了Boot Block、Super Block、GDT、Reserver GDT這幾個概念。下面會分別介紹它們。

然后,圖中指明了塊組中每個部分占用的block數量,除了superblock、bmap、imap能確定占用1個block,其他的部分都不能確定占用幾個block。

最后,圖中指明了Superblock、GDT和Reserved GDT是同時出現且不一定存在于每一個塊組中的,也指明了bmap、imap、inode table和data blocks是每個塊組都有的。

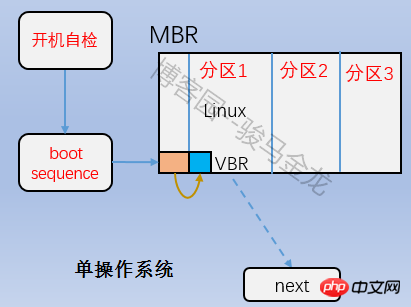

4.2.1 引導塊

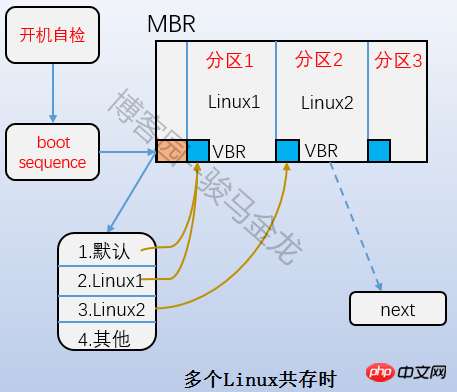

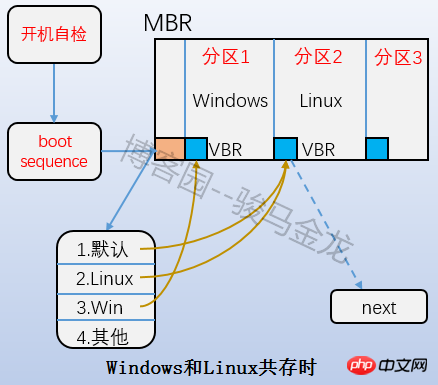

即上圖中的Boot Block部分,也稱為boot sector。它位于分區上的第一個塊,占用1024字節,并非所有分區都有這個boot sector。里面存放的也是boot loader,這段boot loader成為VBR,這里的Boot loader和mbr上的boot loader是存在交錯關系的。開機啟動的時候,首先加載mbr中的bootloader,然后定位到操作系統所在分區的boot serctor上加載此處的boot loader。如果是多系統,加載mbr中的bootloader后會列出操作系統菜單,菜單上的各操作系統指向它們所在分區的boot sector上。它們之間的關系如下圖所示。

4.2.2 超級塊(superblock)

既然一個文件系統會分多個塊組,那么文件系統怎么知道分了多少個塊組呢?每個塊組又有多少block多少inode號等等信息呢?還有,文件系統本身的屬性信息如各種時間戳、block總數量和空閑數量、inode總數量和空閑數量、當前文件系統是否正常、什么時候需要自檢等等,它們又存儲在哪里呢?

毫無疑問,這些信息必須要存儲在block中。存儲這些信息占用1024KB,所以也要一個block,這個block稱為超級塊(superblock),它的block號可能為0也可能為1。如果block大小為1024K,則引導塊正好占用一個block,這個block號為0,所以superblock的號為1;如果block大小大于1024K,則引導塊和超級塊同置在一個block中,這個block號為0。總之superblock的起止位置是第二個1024(1024-2047)字節。

使用df命令讀取的就是每個文件系統的superblock,所以它的統計速度非常快。相反,用du命令查看一個較大目錄的已用空間就非常慢,因為不可避免地要遍歷整個目錄的所有文件。

[root@xuexi ~]# df -hT Filesystem Type Size Used Avail Use% Mounted on/dev/sda3 ext4 18G 1.7G 15G 11% /tmpfs tmpfs 491M 0 491M 0% /dev/shm/dev/sda1 ext4 190M 32M 149M 18% /boot

superblock對于文件系統而言是至關重要的,超級塊丟失或損壞必將導致文件系統的損壞。所以舊式的文件系統將超級塊備份到每一個塊組中,但是這又有所空間浪費,所以ext2文件系統只在塊組0、1和3、5、7冪次方的塊組中保存超級塊的信息,如Group9、Group25等。盡管保存了這么多的superblock,但是文件系統只使用第一個塊組即Group0中超級塊信息來獲取文件系統屬性,只有當Group0上的superblock損壞或丟失才會找下一個備份超級塊復制到Group0中來恢復文件系統。

下圖是一個ext4文件系統的superblock的信息,ext家族的文件系統都能使用dumpe2fs -h獲取。

4.2.3 塊組描述符表(GDT)

既然文件系統劃分了塊組,那么每個塊組的信息和屬性元數據又保存在哪里呢?

ext文件系統每一個塊組信息使用32字節描述,這32個字節稱為塊組描述符,所有塊組的塊組描述符組成塊組描述符表GDT(group descriptor table)。

雖然每個塊組都需要塊組描述符來記錄塊組的信息和屬性元數據,但是不是每個塊組中都存放了塊組描述符。ext文件系統的存儲方式是:將它們組成一個GDT,并將該GDT存放于某些塊組中,存放GDT的塊組和存放superblock和備份superblock的塊相同,也就是說它們是同時出現在某一個塊組中的。

假如block大小為4KB的文件系統劃分了143個塊組,每個塊組描述符32字節,那么GDT就需要143*32=4576字節即兩個block來存放。這兩個GDT block中記錄了所有塊組的塊組信息,且存放GDT的塊組中的GDT都是完全相同的。

下圖是一個塊組描述符的信息(通過dumpe2fs獲取)。

4.2.4 保留GDT(Reserved GDT)

保留GDT用于以后擴容文件系統使用,防止擴容后塊組太多,使得塊組描述符超出當前存儲GDT的blocks。保留GDT和GDT總是同時出現,當然也就和superblock同時出現了。

例如前面143個塊組使用了2個block來存放GDT,但是此時第二個block還空余很多空間,當擴容到一定程度時2個block已經無法再記錄塊組描述符了,這時就需要分配一個或多個Reserverd GDT的block來存放超出的塊組描述符。

由于新增加了GDT block,所以應該讓每一個保存GDT的塊組都同時增加這一個GDT block,所以將保留GDT和GDT存放在同一個塊組中可以直接將保留GDT變換為GDT而無需使用低效的復制手段備份到每個存放GDT的塊組。

同理,新增加了GDT需要修改每個塊組中superblock中的文件系統屬性,所以將superblock和Reserverd GDT/GDT放在一起又能提升效率。

4.3 Data Block

如上圖,除了Data Blocks其他的部分都解釋過了。data block是直接存儲數據的block,但事實上并非如此簡單。

數據所占用的block由文件對應inode記錄中的block指針找到,不同的文件類型,數據block中存儲的內容是不一樣的。以下是Linux中不同類型文件的存儲方式。

-

對于常規文件,文件的數據正常存儲在數據塊中。

-

對于目錄,該目錄下的所有文件和一級子目錄的目錄名存儲在數據塊中。

文件名不是存儲在其自身的inode中,而是存儲在其所在目錄的data block中。

-

對于符號鏈接,如果目標路徑名較短則直接保存在inode中以便更快地查找,如果目標路徑名較長則分配一個數據塊來保存。

-

設備文件、FIFO和socket等特殊文件沒有數據塊,設備文件的主設備號和次設備號保存在inode中。

常規文件的存儲就不解釋了,下面分別解釋特殊文件的存儲方式。

4.3.1 目錄文件的data block

對于目錄文件,其inode記錄中存儲的是目錄的inode號、目錄的屬性元數據和目錄文件的block指針,這里面沒有存儲目錄自身文件名的信息。

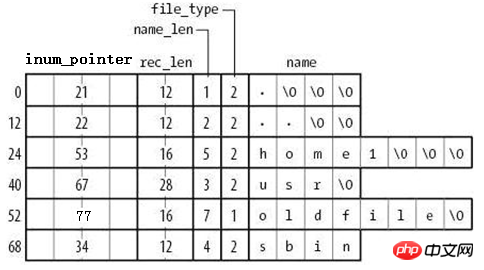

而其data block的存儲方式則如下圖所示。

由圖可知,在目錄文件的數據塊中存儲了其下的文件名、目錄名、目錄本身的相對名稱”.”和上級目錄的相對名稱”..”,還存儲了指向inode table中這些文件名對應的inode號的指針(并非直接存儲inode號碼)、目錄項長度rec_len、文件名長度name_len和文件類型file_type。注意到除了文件本身的inode記錄了文件類型,其所在的目錄的數據塊也記錄了文件類型。由于rec_len只能是4的倍數,所以需要使用” 国产成人精品综合久久久久 | 日韩精品久久久久久| 国产高潮国产高潮久久久| 国产Av激情久久无码天堂| 久久婷婷国产麻豆91天堂| 久久99精品久久久久久噜噜| 亚洲国产成人久久综合野外| 日产精品久久久久久久性色| A级毛片无码久久精品免费| 久久久国产视频| 亚洲国产精品久久久久久| 久久精品女人天堂AV麻| 亚洲色欲久久久综合网东京热 | 99久久精品国产一区二区| 97久久超碰成人精品网站| 亚洲伊人久久综合影院| 日韩精品久久久久久久电影蜜臀 | 久久亚洲欧美日本精品| 精品综合久久久久久98| 激情久久久久久久久久| 国产精品久久久亚洲| 亚洲av成人无码久久精品| 欧美性大战久久久久久| 99久久www免费人成精品| 久久精品国产久精国产思思| 伊人久久大香线蕉综合网站| 国产A级毛片久久久精品毛片| 久久大香香蕉国产| 精品国产乱码久久久久久呢| 久久久久亚洲精品男人的天堂| www.久久热| 97久久精品人妻人人搡人人玩| 久久精品www人人爽人人| 奇米影视7777久久精品人人爽| 久久久久18| 亚洲欧美精品一区久久中文字幕| 久久久久综合国产欧美一区二区| 国内精品伊人久久久久av一坑 | 欧美久久一区二区三区| 久久亚洲精品无码播放| 久久精品女人天堂AV麻|