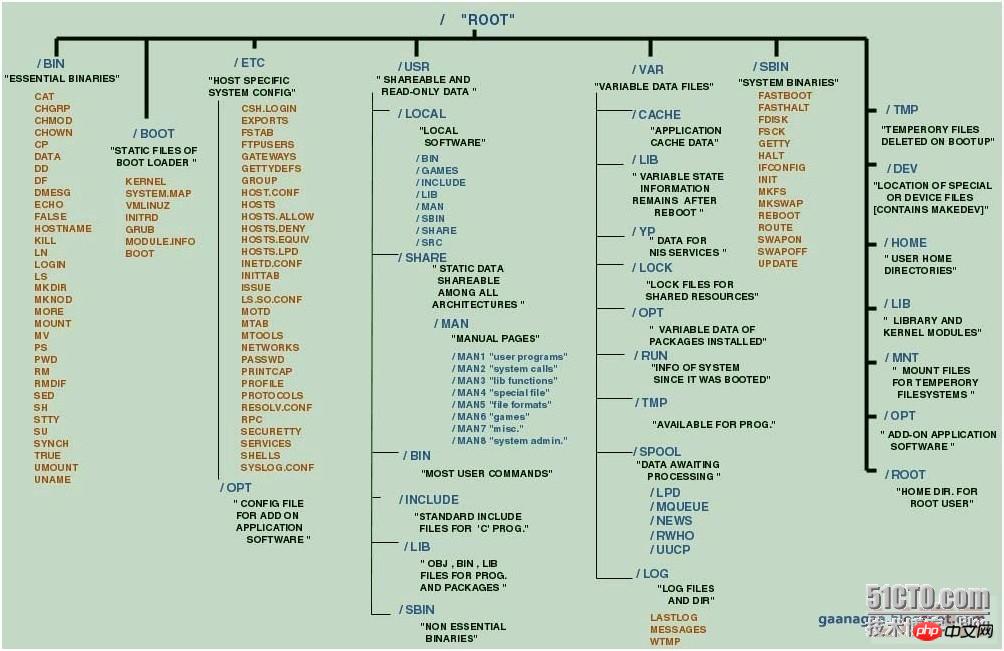

在linux系統中實現hdfs(hadoop分布式文件系統)的高可用性,一般需要執行以下核心步驟:

1. 環境搭建

- 硬件需求:保證有多臺服務器作為集群成員,每臺服務器都已安裝Java與Hadoop。

- 網絡設置:確認各服務器間能夠無障礙通訊。

2. Hadoop部署

于所有服務器上統一安裝指定版本的Hadoop。

3. HDFS設定

修改hdfs-site.xml文件,加入如下配置項:

<configuration><property><name>dfs.nameservices</name><value>mycluster</value></property><property><name>dfs.ha.namenodes.mycluster</name><value>nn1,nn2</value></property><property><name>dfs.namenode.shared.edits.dir</name><value>qjournal://jn1:8485;jn2:8485;jn3:8485/mycluster</value></property><property><name>dfs.client.failover.proxy.provider.mycluster</name><value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value></property><property><name>dfs.ha.fencing.methods</name><value>sshfence</value></property><property><name>dfs.ha.fencing.ssh.private-key-files</name><value>/path/to/private/key</value></property><property><name>dfs.namenode.rpc-address.mycluster.nn1</name><value>nn1:8020</value></property><property><name>dfs.namenode.rpc-address.mycluster.nn2</name><value>nn2:8020</value></property><property><name>dfs.namenode.http-address.mycluster.nn1</name><value>nn1:50070</value></property><property><name>dfs.namenode.http-address.mycluster.nn2</name><value>nn2:50070</value></property><property><name>dfs.namenode.secondary.http-address</name><value>snn:50090</value></property><property><name>dfs.namenode.checkpoint.dir</name><value>/path/to/checkpoint/dir</value></property><property><name>dfs.namenode.checkpoint.edits.dir</name><value>/path/to/edit/log/dir</value></property></configuration>

4. JournalNode配置

更新hdfs-site.xml文件,增加JournalNode的相關配置:

<property><name>dfs.journalnode.edits.dir</name><value>/path/to/journalnode/data</value></property>

5. 啟動JournalNode服務

于每一個JournalNode服務器上運行以下命令以開啟JournalNode服務:

hdfs --daemon start journalnode

6. NameNode初始化

在一個NameNode服務器上執行格式化操作:

hdfs namenode -format

7. NameNode啟動

在同一NameNode服務器上啟動NameNode服務:

hdfs --daemon start namenode

8. NameNode元數據同步

在另一臺NameNode服務器上完成元數據的同步:

hdfs namenode -bootstrapStandby

9. SecondaryNameNode啟動

在SecondaryNameNode服務器上啟動SecondaryNameNode服務:

hdfs --daemon start secondarynamenode

10. DataNode啟動

在所有的DataNode服務器上啟動DataNode服務:

hdfs --daemon start datanode

11. HA配置檢查

利用hdfs haadmin命令檢測HA配置的狀態:

hdfs haadmin -getServiceState nn1 hdfs haadmin -getServiceState nn2

12. 客戶端配置

保障客戶端的core-site.xml文件含有以下配置:

<property><name>fs.defaultFS</name><value>hdfs://mycluster</value></property>

依照上述流程,你便能在Linux平臺上構建HDFS的高可用架構。依據實際狀況調整相關參數及路徑。

? 版權聲明

文章版權歸作者所有,未經允許請勿轉載。

THE END